ИИ-контент в соцсетях: как он меняет наше восприятие

В последние годы контент, созданный искусственным интеллектом, стал привычной частью нашей цифровой жизни. Однако под термином «AI-отходы» скрываются не просто забавные или уникальные изображения – это источник значительно большего беспокойства. Возникшие колебания вокруг них подчеркивают важность подлинности и достоверности информации в социальных сетях. Сегодня, как никогда ранее, пользователи становятся акторами в области критического мышления относительно того, что они видят на экране.

Простыми словами, AI-отходы – это контент, созданный искусственными интеллектами, такие как изображения, текст или видео, которые могут выглядеть реалистично, но зачастую обманывают пользователей своим неточным содержанием. Механизм их создания основан на обучении ИИ на огромных объемах данных, и качество результата зависит от той информации, на которой он "учится". Например, Теодор, студент, представленный в статье, демонстрирует, как можно противостоять недостоверным публикациям, создавая аккаунт в социальной сети и поднимая осведомленность о проблемах, связанных с контентом, генерируемым ИИ. Его усилия показывают, что пользовательский критицизм становится неотъемлемой частью борьбы с ложной информацией.

В то время как контент, созданный ИИ, продолжает привлекать внимание пользователей своей визуальной и развлекательной ценностью, возникает острая необходимость в дебатах о его воздействии на общество. Примеры, как случай Теодора, демонстрируют, что пользователи могут объединиться и действовать, чтобы оценить происходящее, поднимая важные вопросы о механизмах дезинформации и о том, как такие материалы влияют на наше критическое восприятие. Иногда контент может выглядеть привлекательно, но его содержание может вызвать серьезные последствия на уровне общественного сознания, в том числе потерю доверия к информации.

Читайте далее

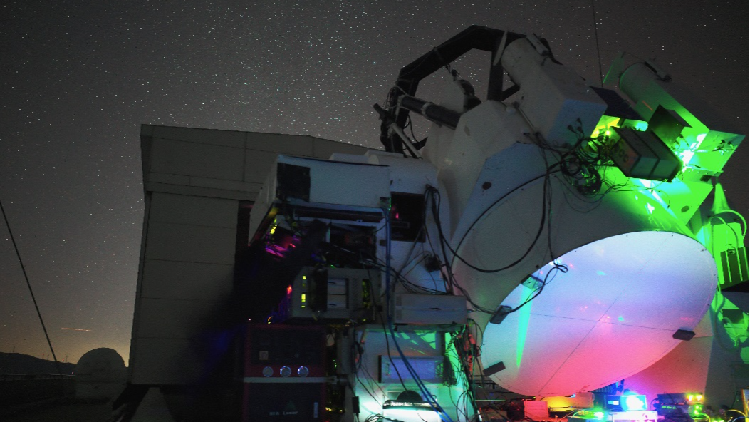

Китайский прорыв в лазерной связи между спутниками и Землей

Китайские исследователи провели успешный эксперимент по лазерной связи, достигнув 1 Гбит/с на расстоянии 40 000 км.

Искусственный интеллект и авторские права: Скандал с Grammarly

Статья обсуждает отключение функции Expert Review в Grammarly, коррелируя это с этическими вопросами использования ИИ и защиты авторских прав.

Китайские больницы борются за управление весом пациентов и качеством услуг

Китайские больницы борются с ожирением по инициативе «Здоровый Китай 2030», предлагая комплексные медицинские вмешательства.