Исследования безопасности в эпоху искусственного интеллекта

С развитием технологий искусственного интеллекта (ИИ) всё больше звучат тревожные голоса о потенциальных угрозах, связанных с их использованием. Глава Google DeepMind сэр Демис Хасабис заявил в недавнем интервью, что срочные исследования по этой теме становятся крайне необходимыми. От его слов становится ясно, что умная регуляция ИИ не только важна, но и критически необходима, чтобы оградить общество от реальных рисков.

ИИ уже применяется в самых различных областях – от медицины и бизнеса до автономного вождения. Однако, как отметил Хасабис, высокие темпы развития технологий могут вызвать нежелательные последствия. Например, "плохие актеры" могут использовать ИИ для создания фейковых новостей или мошенничества. Кроме того, риск потери контроля над автономными системами нарастает, особенно когда речь идет о военных и других высокорисковых областях. Отсутствие регуляции может привести к ситуации, когда ИИ будет действовать против интересов общества, принимая непредсказуемые решения.

На саммите, где обсуждаются угрозы ИИ, послания о необходимости сотрудничества звучали от многих лидеров, включая премьер-министра Индии Нарендра Моди. Однако, интересный контраст возник с позицией США, которые отвергают глобальные регуляции в этой области. Это вызывает умыслительные вопросы: как можно достигнуть безопасного и ответственного использования ИИ, если отсутствует согласованная мировая стратегия? Тем не менее, Хасабис утверждает, что технологии ИИ несут с собой возможность создания "суперсилы" для человечества, если будут правильно использованы. Поэтому, для обеспечения светлого будущего, образование в STEM–областях становится критически важным.

Читайте далее

Исследования безопасности в эпоху искусственного интеллекта

В статье рассматривается необходимость срочных исследований и умной регуляции в области искусственного интеллекта. Выделяются основные угрозы, с которыми сталкивается общество, и подчеркивается важность сотрудничества между технологическими компаниями и правительствами для безопасного развития технологий.

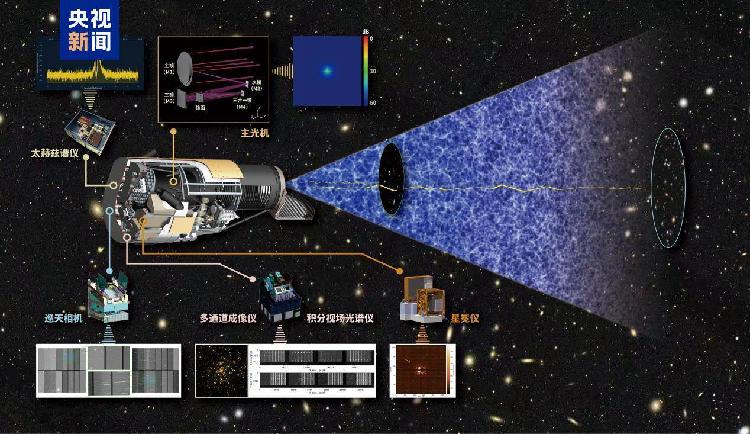

Китайский космический телескоп добился прорыва в научных симуляциях

Китайский телескоп CSST с современными инструментами будет проводить прорывные исследования в астрофизике и космологии.

Неполадки Starliner: уроки для NASA и Boeing

Статья о серьезной неудаче миссии Starliner от Boeing, классифицированной NASA как инцидент типа "А", с акцентом на ее последствия и значение для космических исследований.